【完全版】DeepSeek日本語モデルの特徴や導入方法を徹底解説

近年、大規模言語モデル(LLM)の需要が急速に高まっています。こうした中で注目を集めているのが、中国・杭州市のAI企業「DeepSeek」です。

DeepSeekは、推論能力に特化した大規模言語モデル「DeepSeek-R1」をはじめ、日本語モデルの開発にも注力しており、高い性能とコスト効率を両立させています。

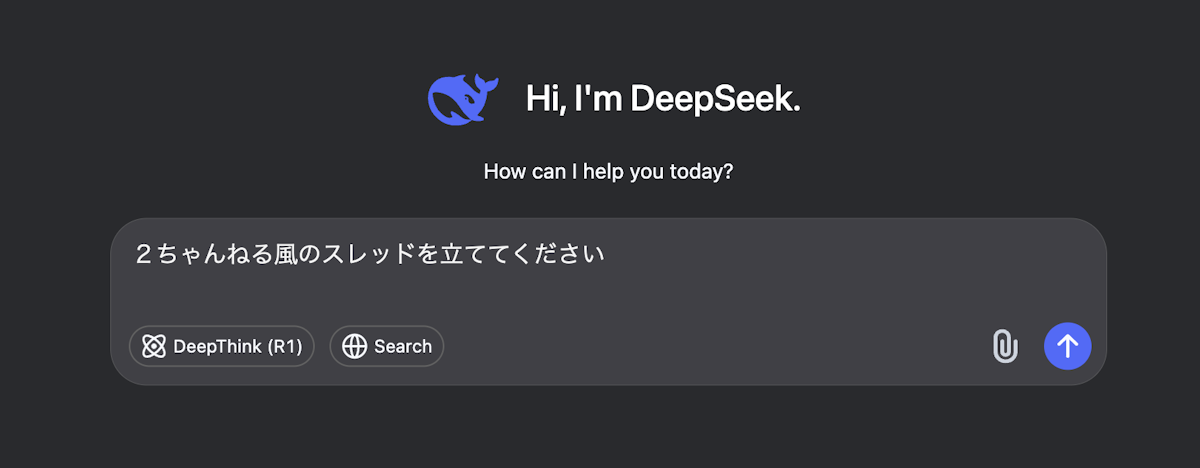

本記事では、DeepSeekの概要や最新モデル「R1」の特徴、日本語モデルの開発背景、さらには環境構築方法を詳しく紹介します。ローカル環境での運用を検討している方や、高度な論理推論や長文処理が求められるプロジェクトをお持ちの方は、ぜひ参考にしてみてください。

AI導入.comを提供する株式会社FirstShift 代表取締役。トロント大学コンピューターサイエンス学科卒業。株式会社ANIFTYを創業後、世界初のブロックチェーンサービスを開発し、東証プライム上場企業に売却。その後、マッキンゼー・アンド・カンパニーにコンサルタントとして入社。マッキンゼー日本オフィス初の生成AIプロジェクトに従事後、株式会社FirstShiftを創業。

DeepSeekとは?

DeepSeekは、中国の杭州市に拠点を置くAI企業で、2023年に設立されました。同社は高性能かつコスト効率に優れた大規模言語モデル(LLM)を提供し、特に**推論能力に特化したモデル「DeepSeek-R1」**で注目を集めています。

OpenAIの「o1」モデルと同等の性能を持ちながら、開発コストを大幅に抑えたことで、AI業界に革新をもたらしています。

DeepSeekの最新モデル「R1」の概要

DeepSeekの「R1」モデルは**、数学やコーディング、論理的推論のタスクにおいて高い性能**を発揮するよう設計されています。

ベンチマークテストでは**、OpenAIの「o1」モデルと同等の精度を示しながら、開発コストは約96%低く**抑えられています。また、最大128Kトークンの長文脈処理能力を持ち、大量のデータや長文タスクにも対応可能です。

DeepSeekの日本語モデルとは?

DeepSeekは、英語以外の言語対応を進めており、日本語モデルの開発も行っています。日本語モデルは、DeepSeek-R1を基盤としており、日本語の自然言語処理タスクにおいて高い性能を目指しています。

これにより、日本語圏のユーザーや企業がDeepSeekの技術を活用しやすくなります。

日本語モデルの開発経緯

DeepSeekは、グローバルな市場展開を視野に入れ、多言語対応を進めています**。**日本語モデルの開発は、日本市場の重要性を認識し、日本語の自然言語処理の需要に応えるために行われています。

現在、日本語モデルはベータ版として提供されており、フィードバックを収集しながら精度向上を図っています。

DeepSeekの日本語モデルの精度

DeepSeekの日本語モデルは、一般的な自然言語処理タスクにおいて一定の精度を示しています。しかし、専門用語や複雑な文脈における理解度には課題が残っており、専門的な分野や方言への対応など、さらなる精度向上が求められています。

今後、ユーザーからのフィードバックを基に、モデルの改善が進められる予定です。

DeepSeekの日本語モデルの環境構築方法

DeepSeekの日本語モデルを利用するには、適切なハードウェアとソフトウェア環境の構築が必要です。以下に、必要な要件と手順を説明します。

必要なハードウェア・ソフトウェア

DeepSeekの日本語モデルを動作させるためには、以下のハードウェアとソフトウェアが必要です。

- ハードウェア:高性能なGPU(例:NVIDIAの最新モデル)、十分なメモリ容量(最低16GB以上)

- ソフトウェア:Python環境、DeepSeekのモデルファイル、関連するライブラリ(例:PyTorch)

日本語モデルを動作させるための必要VRAM

DeepSeekの日本語モデルを動作させるには、最低でも16GBのVRAMを搭載したGPUが推奨されます。モデルのサイズや処理内容によっては、より多くのVRAMが必要となる場合があります。

特に、大規模なデータセットや複雑なタスクを扱う場合は、24GB以上のVRAMを持つGPUが望ましいです。

Windows・Macでの環境構築の違い

WindowsとMacでのDeepSeek環境構築には、主にソフトウェアのインストール手順に違いがあります。

Windowsでは、NVIDIAのGPUを利用するためにCUDAやcuDNNのインストールが必要です。

一方、MacではMetal APIを利用するため、対応するライブラリのインストールが求められます。また、MacのM1チップでは、ARMアーキテクチャに対応したライブラリが必要となります。

DockerでDeepSeekを動かす方法

Dockerを活用することで、DeepSeekの日本語モデルを簡単に導入・実行できます。Dockerはコンテナ技術を利用しており、環境の依存性を排除し、再現性の高い環境構築が可能です。

以下に、Dockerを使用したDeepSeekの導入手順を説明します。

- Dockerのインストール:公式サイトからDockerをダウンロードし、インストールします。

- Docker Composeファイルの作成:DeepSeekのWeb UIを立ち上げるための設定ファイル(docker-compose.yml)を作成します。

- コンテナの起動:作成したDocker Composeファイルを使用して、DeepSeekのコンテナを起動します。

- Webブラウザでアクセス:ブラウザで指定したポートにアクセスし、DeepSeekのWeb UIを利用します。

Hugging Face TransformersでDeepSeekを実装する方法

Hugging FaceのTransformersライブラリを利用することで、DeepSeekの日本語モデルを簡単に導入・活用できます。Transformersは、様々な言語モデルをサポートしており、DeepSeekもその一つです。

以下に、Hugging Faceを使ったDeepSeekの導入手順を説明します。

- Transformersのインストール:Python環境で

pip install transformersを実行し、ライブラリをインストールします。 - モデルのダウンロード:Hugging FaceのモデルリポジトリからDeepSeekの日本語モデルをダウンロードします。

- モデルのロード:Transformersの

AutoModelやAutoTokenizerを使用して、モデルとトークナイザーをロードします。 - 推論の実行:ロードしたモデルを使用して、テキスト生成や分類などのタスクを実行します。

Ollama + PythonでDeepSeekを動かす方法

Ollamaは、ローカル環境で大規模言語モデルを実行するためのオープンソースツールです。Pythonと組み合わせることで、DeepSeekの日本語モデルを簡単に実行できます。

以下に、OllamaとPythonを活用したDeepSeekの導入手順を説明します。

- Ollamaのインストール:公式サイトからOllamaをダウンロードし、インストールします。

- モデルのダウンロード:Ollamaを使用して、DeepSeekの日本語モデルをダウンロードします。

- Python環境の設定:PythonでOllamaのAPIを利用するためのライブラリをインストールします。

- モデルの実行:Pythonスクリプトを作成し、OllamaのAPIを通じてDeepSeekモデルを実行します。

どんな用途でDeepSeek日本語モデルが活用できるか

DeepSeekの日本語モデルは、以下のような用途で活用が期待されます。

- コーディング支援:複数のプログラミング言語でのコード生成やデバッグをサポートし、開発者の生産性向上に寄与します。

- 数学的推論:複雑な数学問題の解決や論理的推論を行い、教育や研究分野での活用が見込まれます。

- コンテンツ生成:ニュース記事やブログ、フィクションなど、多岐にわたるジャンルのコンテンツ作成を支援します。

- 翻訳と字幕生成:多言語対応により、国際的なコミュニケーションをサポートし、ビジネスやエンターテインメント分野での利用が期待されます。

これらの活用により、DeepSeekの日本語モデルは幅広い分野での業務効率化や創造性の向上に貢献することが期待されます。

まとめ

DeepSeekの日本語モデルはコストを抑えつつGPT-4級の論理推論を導入できる選択肢といえます。

またオープンソースモデルなので、オンプレ運用で機密情報を外に出さずに使いたい企業や、論理的推論が得意なAIを探している教育機関にとって有力な候補となっています。

ただし政治的バイアスや応答速度、ハルシネーション対策などの課題もあるため、実運用では独自調整や外部知識との組み合わせが重要です。

AIサービス導入のご相談は AI導入.com へ(無料)

AI導入.comでは、マッキンゼー・アンド・カンパニーで生成AIプロジェクトに従事した代表を中心に、日本・アメリカの最先端のAIサービスの知見を集めています。AIサービスの導入に関するご相談やお問い合わせを無料で承っております。ビジネスの競争力を高めるために、ぜひ以下のお問い合わせフォームよりご連絡ください。