【完全版】LLMファインチューニングの方法と活用法5選

LLM(大規模言語モデル)のファインチューニングは、特定のタスクやドメインにモデルを適応させるための重要な手法です。

事前に学習したモデルをさらに特化させ、精度や反応速度を向上させることが可能です。

本記事では、LLMファインチューニングの基本的な概念から、実際の手法、活用例、コスト最適化の方法までを詳細に解説していきます。

AI導入.comを提供する株式会社FirstShift 代表取締役。トロント大学コンピューターサイエンス学科卒業。株式会社ANIFTYを創業後、世界初のブロックチェーンサービスを開発し、東証プライム上場企業に売却。その後、マッキンゼー・アンド・カンパニーにコンサルタントとして入社。マッキンゼー日本オフィス初の生成AIプロジェクトに従事後、株式会社FirstShiftを創業。

LLMファインチューニングとは

ImageFXで作成

LLMファインチューニングは、事前学習済みの大規模言語モデルを特定のタスクや領域に特化して学習させるプロセスです。

このプロセスによって、モデルは一般的な知識からより専門的な知識に対応し、タスクに特化した精度と反応速度を向上させます。

LLMファインチューニングでは、「文章生成・質問応答・感情分析」などの特定の用途に最適化されます。

LLMファインチューニングとRAGの違い

ImageFXで作成

LLMファインチューニングは、事前学習したモデルのパラメータを調整して、特定のタスクに最適化する方法です。

このモデルは、特定のドメインやタスクにおいて高いパフォーマンスを発揮します。

対照的に、RAG(Retrieval-Augmented Generation)は外部のデータベースから情報を取得して生成プロセスに組み込むことで、常に最新の情報や高度な専門知識を活用する手法です。

ファインチューニングはモデルの「記憶」を特定タスクに特化させるのに対し、RAGは外部のリソースを動的に利用します。

【知識編】LLMファインチューニングの種類

ImageFXで作成

LLMファインチューニングにはいくつかのアプローチがあります。

目的や使用するリソースによって最適な方法が異なるため、それぞれの手法の特徴を理解することが重要です。

次に、代表的な2つのファインチューニング方法について説明します。

フルファインチューニング

モデルの全パラメータを更新して、特定のデータセットやタスクに深く適応させる手法です。

この方法は非常に高い適応性を誇る一方で、多くの計算資源と時間が必要です。

主に大規模な翻訳システムや特定の専門領域における質問応答システムなど、高いパフォーマンスが要求されるアプリケーションの使用に適用されます。

特に、特定言語ペアの翻訳・医療・法律などの専門分野で高精度な回答を提供するためにフルファインチューニングが施されます。

軽量ファインチューニング

モデルの一部のパラメータのみを更新し、全体のパラメータ構造を維持しつつ効率的にタスク特化する手法です。

計算資源の制限がある環境でも効率的にモデルを適応させることが可能で、小規模アプリケーションやモバイルデバイスでの使用やリアルタイム応答が求められるウェブアプリケーションに利用されます。

軽量ファインチューニングはLoRAやMoRAといった技術を活用することで、限られた計算資源でも効率的にモデルを適応させることができます。

- LoRA(Low-Rank Adaptation):モデルのパラメータを低ランクの行列で効率的に調整し、計算負荷を低減。

- MoRA(Moist Rank Adaptation):類似または関連する技術で、特定のパラメータのみを微調整して効率を向上。

【実践編】LLMファインチューニングのやり方

ImageFXで作成

LLMファインチューニングは実践的な手法が求められます。

以下では、ファインチューニングの実際のステップを具体的に解説します。

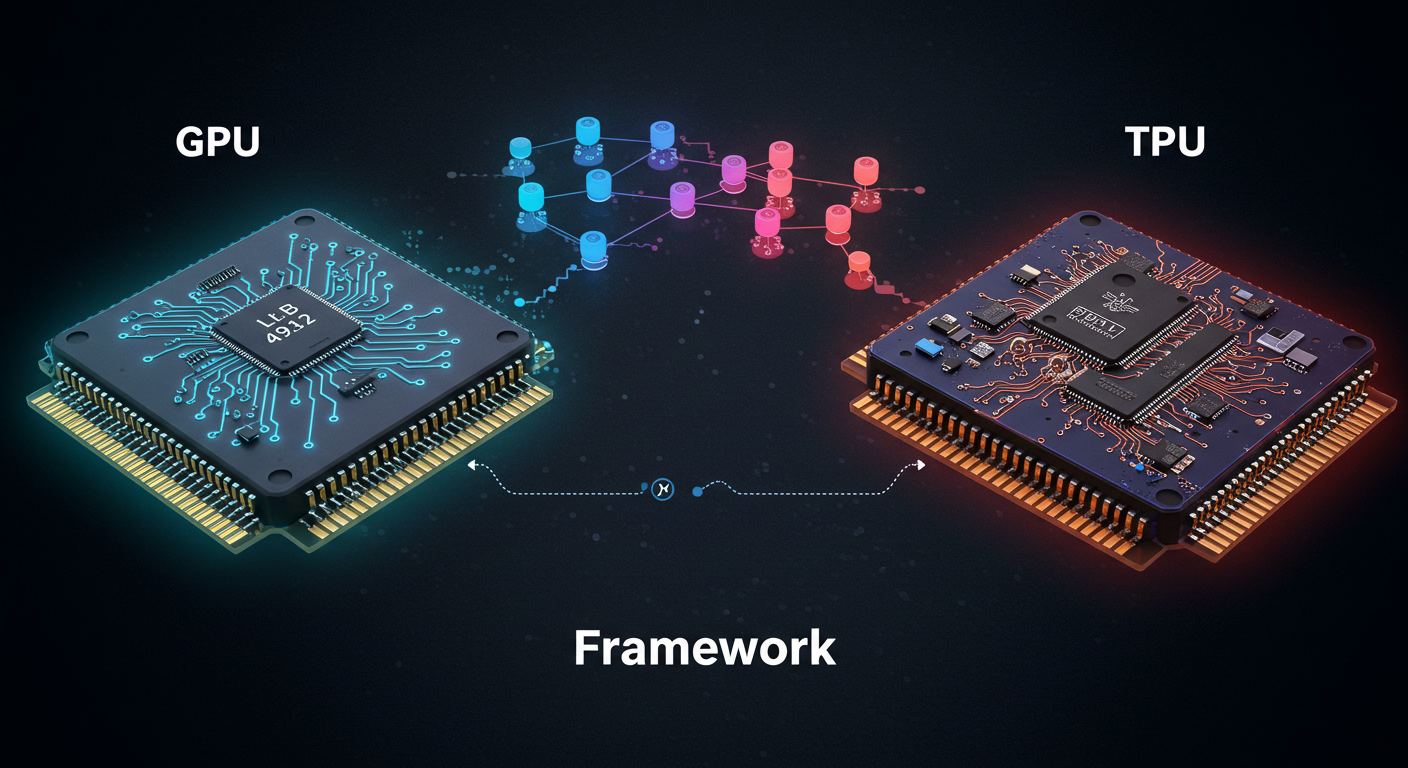

STEP 1|環境・ツールの準備

ImageFXで作成

環境・ツールの準備 LLMファインチューニングを開始する前には、適切な開発環境とツールを整える必要があります。

Python・PyTorch・TensorFlowといったフレームワークの準備と、GPUやTPUといったハードウェアリソースの確保が必要です。

- フレームワーク:PythonにPyTorchやTensorFlowをインストールし、モデルの構築とトレーニングを行う。

- GPU(Graphics Processing Unit):並列処理により、大規模なデータを高速で処理する。

- TPU(Tensor Processing Unit):テンソル計算に特化したGoogle製のプロセッサで、ディープラーニングを効率化。

STEP 2|モデル選定・データセット準備

ImageFXで作成

特定のタスクに最適なモデル(テキスト生成・画像分類・音声認識など、用途に応じた適切なモデル)を選択し、その目的に適したデータセットを用意することが重要です。

データセットの準備には、データの前処理とアノテーションがプロセスの重要となります。

- データの前処理:データに含まれるノイズや無駄な情報を取り除いたり、モデルが理解しやすい形式に整える作業です。

- アノテーション:データにラベルを付ける作業で、「この文章はポジティブかネガティブか」というラベルを付けることです。

このプロセスをしっかり行うことで、モデルの学習効果が高まります。

STEP 3|ファインチューニングの実行

ImageFXで作成

選定したモデルとデータセットを用いて、ファインチューニングを実行します。

ハイパーパラメータの調整や、過学習を防ぐための工夫が求められます。

- ハイパーパラメータの調整: 重要なハイパーパラメータには学習率・バッチサイズ・エポック数が含まれ、これらを適切に設定することでモデルの学習効率と性能が大きく変わります。

- 過学習の防止: 適切なバリデーションセット(検証データセット)での性能監視や、早期停止のようなテクニックが用いられます。トレーニング中にモデルが過剰に特定のパターンを学習しないように配慮が必要です。

STEP 4|モニタリングと改善

ImageFXで作成

トレーニング中のモデルの性能をモニタリングし、必要に応じて改善を行います。

評価指標を用いてモデルの効果を測定し、最適化を図ります。

モニタリングと改善を行うための主要な活動を詳しく見ていきましょう。

パフォーマンスの追跡

トレーニング中、各エポックでの損失率を計測して記録します。

平均損失の追跡は、モデルがどれだけ効果的に学習しているかの指標です。

学習率の調整は、このプロセスの重要な部分で、特定のエポック後に自動的に減少させることでモデルの収束を改善します。

評価指標の使用

精度・リコール・F1スコアなどの評価指標を用いて、モデルの性能を定期的に評価します。

評価指標を使うことで、モデルが過学習や未学習でないかを判断し、調整が必要かどうかの判断が可能です。

リアルタイムのフィードバック

実時間でのフィードバックを通じて、モデルの予測精度を監視して予測と実際の値との誤差を評価します。

これは、モデルが新しいデータに対してどれだけうまく適応しているかを理解するのに役立ちます。

データの変動の監視

データの特性が時間とともにドリフト(変化)する可能性があるため監視し、モデルが新しいデータのパターンに対応できるようにします。

データの変動やモデルのドリフトを検出するために、統計的テストやビジュアル分析が行われます。

モデルの更新と再トレーニング

モデルの性能が目標基準を満たさない場合やデータの変化により性能が低下した場合は、モデルを再トレーニングする必要があります。

これには、新しいデータを用いてモデルを**再学習(再ファインチューニング)**させることが含まれます。

LLMファインチューニングの活用例5選

ImageFXで作成

LLM(大規模言語モデル)ファインチューニングの応用は多岐にわたります。

そこで、特に注目すべき5つの具体例を挙げ、それぞれの活用法を詳しく解説します。

カスタマーサポートチャットボット

ファインチューニングを施したLLMは、顧客からの問い合わせに対してより精度の高い返答をするチャットボットを提供します。

特に企業固有のFAQや問い合わせ履歴を学習させることで、個別化された正確な回答を提供するなどの顧客のニーズに合わせたカスタマイズが可能です。

問い合わせの内容に基づき、最適な応答や解決策を自動的に提案する調整が可能です。

文章生成ツール

専門的な文体や特定のトピックに対応した文章生成ツールは、ファインチューニングによって様々な用途にカスタマイズすることが可能です。

特定のジャンルやフォーマットの「法律文書・ニュース記事・学術論文」などの内容に合わせた文書を生成することが可能です。

コンテンツの品質と一貫性が保たれて生産性の向上が見込めるため、技術文書・創作物やレポート作成にも利用されます。

感情分析システム

SNSやレビューサイトなどのユーザー生成コンテンツから感情や意見を分析するシステムも、LLMのファインチューニングを利用して精度向上が可能です。

顧客の感情や市場動向分析でトレンドをリアルタイムに把握することで、マーケティング戦略や製品開発に活かすことが可能となります。

ファインチューニングは、さらなる顧客満足度の向上を図る目的で活用されています。

医療文書の自動要約

医療分野では、専門的な用語やプロセスが多く診断報告書や治療計画などの専門文書の効率的な要約が必要です。

医療従事者が迅速に情報を把握して意思決定をサポートするためにLLMのファインチューニングが活用されています。

医療文書や研究レポートの質の高い要約を自動化することで、患者ケアの質を向上させ医療従事者の負担を軽減することに役立っています。

プログラミング支援ツール

プログラミングコードの自動生成・バグ検出・ドキュメント生成を支援するツールも、ファインチューニングされたLLMを用いることで効率的に実現できます。

LLMをファインチューニングすることで、ソフトウェア開発の速度と品質を向上させ、開発者の生産性を大幅に向上させることが可能です。

プログラミング支援ツールの精度を上げ、開発者をより創造的な作業に集中できるように活用されています。

LLMファインチューニングのコスト最適化方法

ImageFXで作成

LLMファインチューニングを行う際には、コスト効率の良い方法を採用することが重要です。

ここでは、コストを最適化するための具体的な手法を紹介します。

インフラコストの最適化

クラウドサービスやオンプレミスで利用されるGPUリソースを最適化することで、トレーニングや推論のコストを効果的に削減します。

こうした効率的なリソース管理は、コスト削減に不可欠です。

学習プロセスの最適化

トレーニングデータの選択・バッチサイズの最適化や早期停止などの手法を用いて、学習プロセスを効率化して不要な計算コストを削減します。

これらの最適化手法は、全体的なコスト効率を向上させるために重要です。

人的リソースの最適化

専門知識を持つ人材の育成や外部の専門家との連携により、プロジェクトの効率化と品質向上を同時に向上させます。

チーム全体のスキルアップは、持続可能なコスト効率の向上につながります。

まとめ

ImageFXで作成

本記事では、LLM(大規模言語モデル)のファインチューニングについて解説しました。

ファインチューニングは、事前学習済みモデルを特定のタスクやドメインに適応させる手法で、LLMモデルの精度と反応速度を向上させます。

LLMにはカスタマーサポートや文章生成、感情分析によるマーケティングなど多くの応用例があり、ファインチューニングによる最適化が重要です。

実行には、環境設定・モデル選定、目的に応じてファインチューニング方法を選び、モニタリングをしながら最適化します。

最終的に、LLMファインチューニングは業務効率化と精度向上を実現し、コスト最適化と高いROI(投資収益率)を促進します。